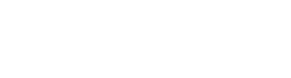

「スマホで撮った自分の顔と、鏡で見る自分の顔が違う!どっちが本当なんですか?」という、そういう疑問を持つ人がかなり多いようなので、その答えとなぜそうなるのかということを詳しく解説します。

まあこれは、左右逆に見えるということ以外では鏡を肉眼で見たときの顔が自分の顔に一番近いわけですが、スマホのカメラで撮ったときになぜ変わってしまうのかというのは理由が多くあります。このメカニズムを詳しく解説したサイトがないので記事を書くことにしました。

また自分の顔になるだけ近づけて撮る方法も解説します(※証明写真撮影法ではありませんのであしからず)。

カメラの写真が肉眼と違う理由は3つ

- レンズ効果やレンズ収差で顔がゆがむ。

- カメラは構造上、正確な色は出ない。

- 肉眼よりダイナミックレンジが遥かに狭い。

では詳しく解説します。

レンズ効果やレンズ収差で顔がゆがむ

カメラはレンズを通した画像です。もちろん人間の目もレンズを通した画像ですが、カメラのレンズはどのレンズで撮影しても同じ顔に写るわけではありません。

スマホの標準カメラではフルサイズセンサーカメラ換算で24mmや28mm相当の広角レンズにされていることが多く、それに対し人間の目は50mmレンズに相当すると言われています。人間の目が50mmレンズ相当というのは画角(目で見える範囲、視野角)のことではなく、レンズ圧縮効果のレベルです。

圧縮効果は望遠レンズほど強く、これが強いほど近くと遠くの被写体が同じような大きさで写ります。いわゆる遠近感が薄くなります。対して広角レンズというのは近くのものが大きく、遠くのものは小さく写ります。これが顔の歪みに繋がります。

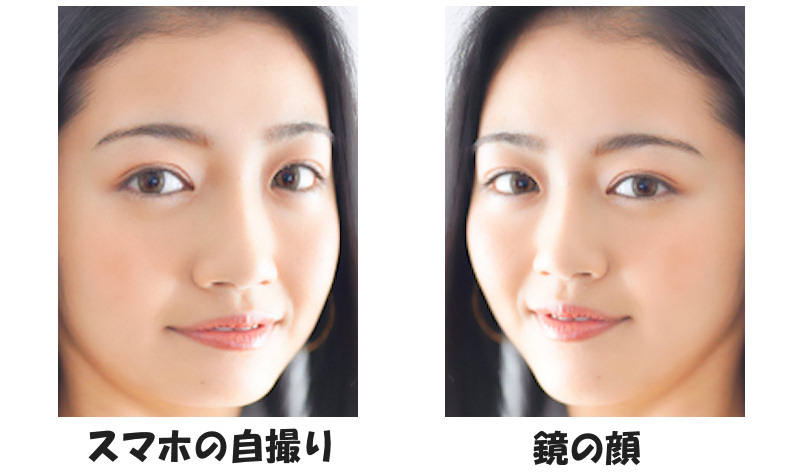

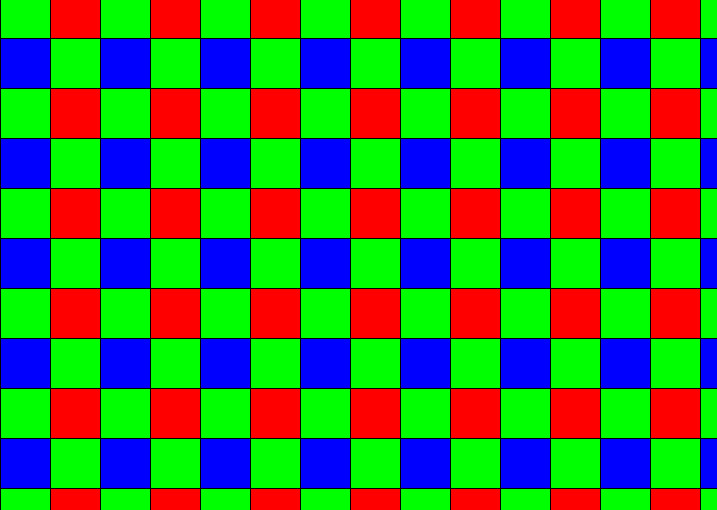

下はAPS-Cサイズセンサーのデジイチで撮影した写真です。形の違いが分かるでしょうか?

目で見た形に近いのは右側の方です。左側はレンズの樽型収差が少し出て時計が丸みを帯びてしまいました。また各左右で文字盤の大きさの違いなどが出ています。目で見た形に近いのは右側の方です。

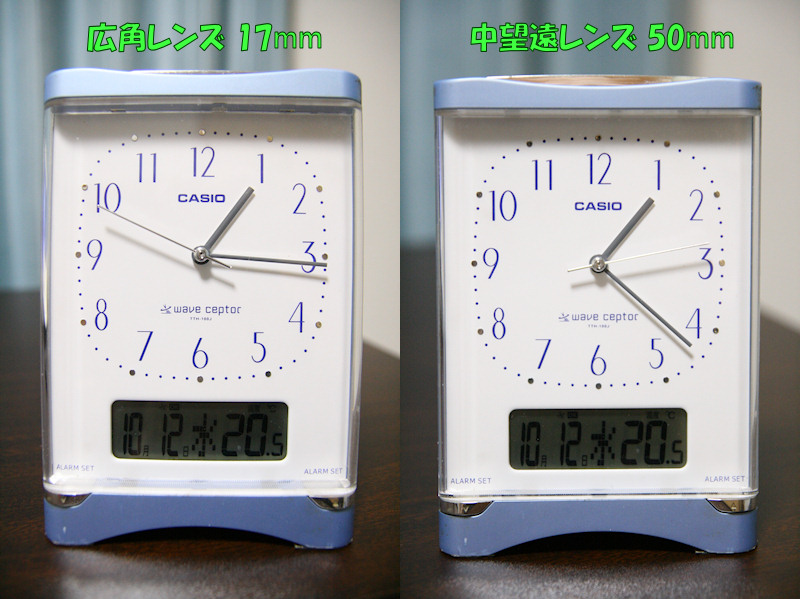

斜めから撮影すると顕著に違いが出ます。これも目で見た形に近いのは右側の方です。

この広角レンズの遠近感はパースペクティブ効果と言われ、被写体が歪むため、個人の顔を大きく写す人物撮影には向いていません。被写体に近づいて写すほどその効果は強く現れます。

集団写真の場合でも、画面いっぱいに入れると画面隅にいる人は引き伸ばされて大きく写ってしまい、中央部は小さくなってしまいます。

またこれは垂直に立った被写体を撮影する時、水平ではなく斜めにカメラを構えた場合、形が大きく歪むことになります。これは撮影距離が近いほど顕著に現れます。

カメラで人の顔をなるだけ歪まないように撮影するためには、中望遠以上(50mm相当を超える)のレンズを使うか、広角で撮る場合は被写体から十分に離れ、被写体とカメラのセンサー面が平行になるようにすること。

人の目は50mmレンズの圧縮効果であるため、50mmレンズ(フルサイズカメラ換算50mm相当レンズでも近い効果は得られる)撮影すれば人の目から見たものに近い形状となります。

正確な色が出ない

スマホで写真を撮ると目で見るより血色の悪い赤みが全くない肌の色になったり、または赤くなりすぎたり、あるいは黄色っぽかったりします。

これはスマホカメラだけでなくデジタルカメラ全般に言えますが、撮った写真は人間の目で見た色を正確に再現しているわけではありません。

デジタルカメラ(スマホカメラもデジタルカメラである)はセンサーにあるRGB(赤・緑・青)のカラーフィルターを通し、各色を合成・補間してフルカラーの1ドットを作り出します。このRGBフィルターの配置はメーカーによって異なり、解像力や発色に影響します。

ホワイトバランスの影響もあります。通常はオートホワイトバランスが動作していて、白が白くなるように調整されます。もちろん人間の目にもホワイトバランスがあります。

カメラのホワイトバランスで、例えば色温度をデイライトの5200Kに固定して早朝の日陰を撮影すると、目で見るよりも色が青っぽく写ります。ホワイトバランスはこれを補正するものです。

カメラのホワイトバランスは人間の目(実際は脳で画像が生成されるが)とはメカニズムが全く異なります。またカメラのホワイトバランスはメーカーやカメラ機種によって強さや味付けが異なります。このホワイトバランスのさじ加減で肌の色が鏡で見る自分とは明らかに異なる様に見えることがあります。

またカメラの画像エンジンで色合いが変わります。画像エンジンとはカメラのセンサーから得た情報をもとに画像を生成するものです。画像エンジンはメーカーや機種によって味付けが異なり、出来上がる絵は千差万別です。

画像エンジンでは一般的に実際の色のイメージではなく記憶色をイメージして味付けされています。

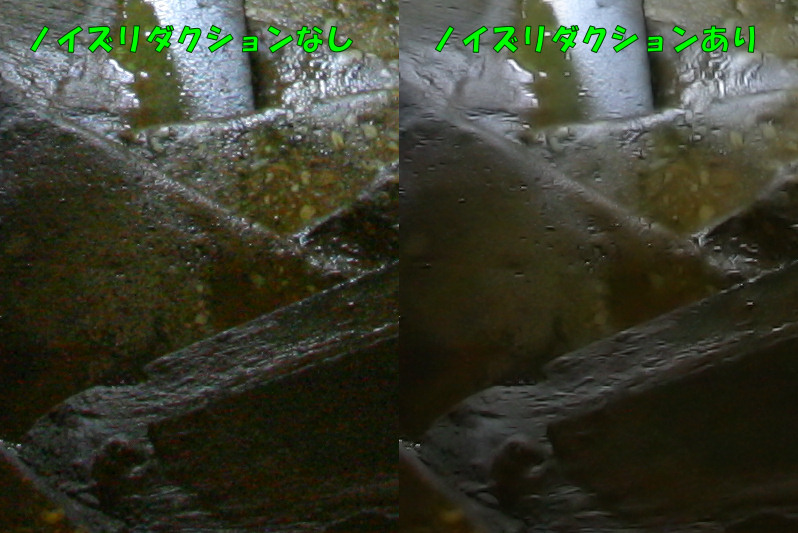

この画像エンジンでノイズリダクション(デジタルカメラのノイズを消すフィルタ)やシャープネスがかけられます。ノイズリダクションは輪郭以外をなめらかにするようなフィルタですが、これが強すぎると顔の毛穴や小さなシミまで消えて肌がなめらかになってしまい、目で見た感じとは変わってしまいます。

スマホなど最近のカメラは自動的にこのノイズリダクションがかけられています。特に極小ピクセルピッチのスマホはノイズが発生しやすく、このフィルタが強くかけられます。やりすぎるとディティールが潰れ、べっとりした画像に。

こうやって目で見た感じとはどんどんかけ離れてきます。

またポートレートをAIで自動判別し、美肌モードで勝手にシミやシワを薄くしたり肌色を暖かみがあるような色合いにしたりすることもあり、そうなると鏡で写る顔とは全く異なって見えることになります。

さらにカメラの画像は人間の眼より色飽和が起こりやすく、色飽和が起こるとベッタリとした立体感がない写真になってしまいます。

色飽和は色が鮮やかな被写体で起こりやすいです。

つまりカメラ(デジタルカメラ)というのは人の目で見る色とは異なるのです。

さらにモニタ(スマホ画面やパソコン画面)の表現力も影響します。モニタによって発色が異なり、同じような色が再現されるわけではありません。これは機種によって異なりますが、同じ機種でも個体差があります。

発色にクセがあると、赤っぽく見えたり、黄色っぽかったり、青っぽかったりするのです。また色の鮮やかさも異なります。これらは調整できる場合もありますが、完全に補正できるわけではありません。

ダイナミックレンジが狭い

写真におけるダイナミックレンジとは明暗差の表現力のこと。

デジタルカメラ(スマホもデジタルカメラである)はこのダイナミックレンジが肉眼よりとても狭い。明るい部分はすぐ白飛びし、暗い部分はすぐに黒つぶれして、描写されない。

下のマッターホルンの朝焼けの写真を見てみましょう。写真では山の露出に合わせると街中が真っ暗になってしまいます。実際は街中はこれほど暗くはなく、右の写真の程の明るさですが、街中に露出を合わせると、山が白飛びを起こします。人の目ではこの両方がしっかり見えています。

肉眼はこの幅が非常に広いのです。人物撮影も当然この影響は出ます。つまりカメラに写った顔の影は黒く潰れやすく、ハイライトは白飛びし易いのです。白飛びしないように写せは顔が暗くなり、顔の明るさを肉眼に合わせると白飛びしやすくなります。

最近のカメラにはHDR(ハイダイナミックレンジ)モードもありますがあれと同じくらい人の目は明暗差に強いのです。ただ、色再現や階調表現的な問題もあり、HDRを使っても肉眼のようには再現しません。むしろHDRはやり過ぎると明るい部分と暗い部分のバランスが崩れ、のっぺりして不自然になる場合もあります。

またモニタ(スマホ画面やパソコン画面)にもダイナミックレンジがあります。一定の輝度になると白飛びしたり、輝度が下がると黒く潰れたりします。この範囲が機種によって異なります。

つまり鏡に映る自分とは異なるのです。

スマホより鏡が正しい姿である

スマホに写した自分の顔は実際に見える顔とはずいぶん異なるということです。スマホでは顔が歪み、色は濃くなり、シミやシワが消え、立体感が薄れます。

鏡で見る顔のほうがはるかに自分の顔に近いといえます。

もちろん鏡は反転した姿です。人間の顔は左右対称ではありませんし、ホクロがあればその位置も左右反転します。さらに鏡は平面とは限らず、鏡によっては意図的に僅かに湾曲させているものもあります。とは言え、それは身体を細く見せたり足を長く見せるためのもので、一般的な洗面台などの半身鏡ではほぼそのままの姿と考えていいでしょう。

スマホで自撮りをして、なんか変な顔になって気になってしまうという人も、それは広角レンズで歪んでいる可能性もあるため心配はしなくていいということです。

なるだけ自分の顔の形に近づけて写したい場合は、中望遠カメラで写す。もし広角レンズで写す場合は近いほど歪むので距離を離して撮影する。また斜めに傾けないで顔とスマホのカメラセンサー面を平行(顔が垂直の場合はスマホも垂直)に構えるようにしましょう。